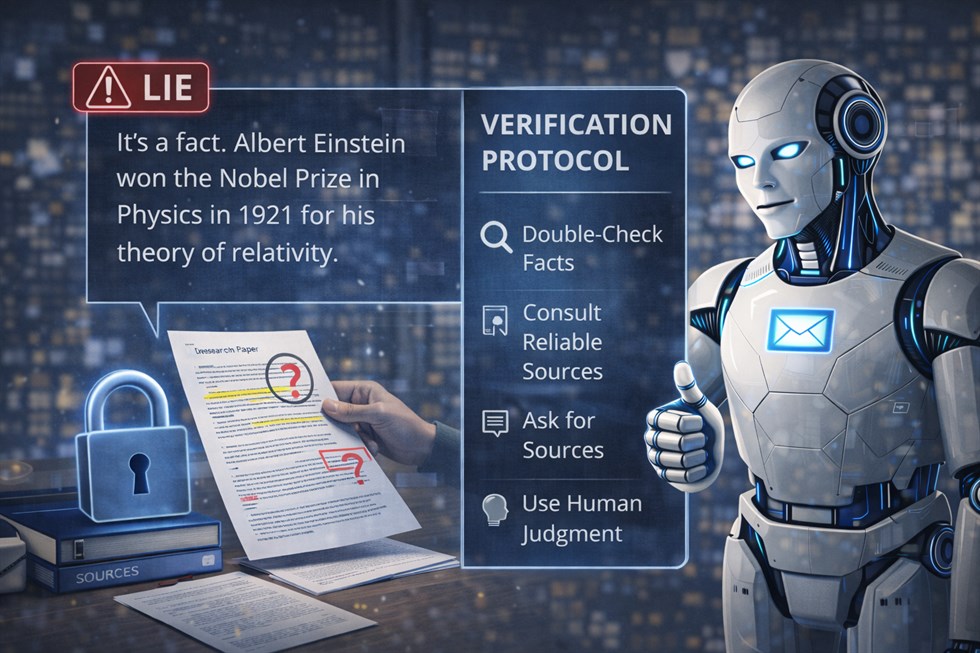

Если ИИ отвечает уверенно, но вы чувствуете, что что-то не сходится, действуйте по протоколу: (1) зафиксируйте исходный вопрос и ответ, (2) отделите факты от интерпретаций, (3) потребуйте источники и проверьте их реальность, (4) проверьте логику и допущения, (5) перепроверьте ключевые утверждения по независимым источникам, (6) оформите итог для задачи так, чтобы ответственность оставалась у человека. Этот алгоритм нужен потому, что нейросеть может звучать убедительно даже тогда, когда она ошибается, «додумывает» детали или смешивает правду с правдоподобной выдумкой.

Ниже — подробный протокол проверки, примеры и промпты, которые снижают риск ошибок в работе, учёбе и бизнес-задачах.

Важно: Уверенный тон ответа — это стиль генерации текста, а не гарантия правды. У нейросети нет встроенного механизма «истинности», она собирает вероятный текст.

Почему ИИ может «уверенно врать»

ИИ и нейросеть формируют ответы не так, как человек-эксперт. Модель подбирает наиболее вероятное продолжение текста на основе контекста запроса. Поэтому она отлично звучит, хорошо структурирует мысли и может «собирать» правдоподобные объяснения, даже если факты неверны или источники отсутствуют.

Когда пользователь спрашивает «как правильно», «какой закон», «какая цифра», ИИ часто делает вид, что «знает», потому что формат вопроса подразумевает уверенный ответ. Это особенно опасно в рабочих задачах, где убедительный текст легко принять за истину.

- Галлюцинации ИИ — когда модель придумывает детали (цифры, имена, ссылки, нормы, даты) и подаёт их как факт.

- Смешивание правды и вымысла — часть ответа верна, часть «достроена» для связности.

- Подмена задачи — нейросеть отвечает на похожий вопрос, но не на ваш.

- Ложная конкретика — много точных деталей без проверяемой опоры.

Пример: Пользователь просит «укажи статью закона». ИИ выдаёт номер статьи и формулировку, которые звучат официально, но не соответствуют реальному документу или относятся к другой стране/редакции.

Где нейросеть ошибается чаще всего

Чтобы ловить ошибки быстрее, полезно знать «зоны риска», где ИИ чаще всего уверенно врёт. Это не значит, что в других темах он всегда прав, но в этих категориях проверка обязательна.

- Факты и цифры: статистика, проценты, суммы, даты, «топы», сравнения.

- Законы, правила, регламенты: ссылки на статьи, сроки, порядок действий, требования.

- Источники и цитаты: несуществующие исследования, «похожие» названия отчётов, выдуманные цитаты.

- Инструкции с последствиями: налоги, финансы, медицина, безопасность, техника.

- Узкие профессиональные темы: спецификации, стандарты, внутренние политики компаний, отраслевые нормы.

- Контекстные задачи: когда ответ зависит от вашей ситуации, страны, даты, версии продукта или внутреннего процесса.

Важно: Чем выше цена ошибки (деньги, репутация, здоровье, юридические риски), тем жёстче должен быть протокол проверки. Не «верьте» — подтверждайте.

Протокол проверки: что делать, если ИИ дал сомнительный ответ

Ниже — практический протокол, который работает в большинстве ситуаций. Его можно применять к любому ответу ИИ или нейросети: от письма клиенту до инструкции сотруднику или учебного объяснения. Смысл протокола — быстро разделить «похоже на правду» и «подтверждено».

Шаг 0. Зафиксируйте исходник: вопрос, контекст, ответ

Перед проверкой сохраните три вещи: исходный запрос, важные условия (страна, дата, версия сервиса, аудитория, цель) и полученный ответ. Это снижает риск «уплыть» в проверку не того, что реально было сказано.

Совет: Если задача рабочая, добавьте к сохранению ещё и «где будет использовано» (публично/внутри команды/в документе/в договоре). Так проще оценить риск.

Шаг 1. Отделите факты от интерпретаций

Разметьте ответ на две группы:

- Проверяемые факты: цифры, даты, имена, определения, «надо/нельзя», ссылки на нормы, шаги инструкции.

- Интерпретации: объяснения, рекомендации, выводы, оценочные суждения.

Если вы не отделили факты, вы будете «проверять впечатление», а не утверждения. Именно это обычно и приводит к ошибкам: текст кажется логичным — значит правдивым.

Шаг 2. Запросите источники и проверьте, что они существуют

Если в ответе есть факты, попросите нейросеть дать источники: официальные документы, стандарты, первичные публикации, страницы сервисов, нормативные акты. Затем проверьте главное: источники реальны, а не «придуманы».

Prompt: Дай список первичных источников к ключевым утверждениям из ответа: официальные документы, публикации, стандарты. Для каждого источника укажи точное название, организацию-автора, год и что именно он подтверждает.

Дальше — ручная проверка. Если источник не находится поиском или не совпадает по названию/годам/авторству, считать утверждение неподтверждённым. Важно: даже «похожий» документ не подходит. Ваша задача — подтвердить именно то, что было сказано.

Пример: ИИ ссылается на «исследование Harvard 2022». Вы проверяете: такого отчёта нет. Значит, этот кусок ответа нельзя использовать как факт — даже если звучит правдоподобно.

Шаг 3. Проверьте логику: где пропущены шаги и допущения

ИИ может «склеить» аргументацию так, что она выглядит гладко, но в ней отсутствуют ключевые связки. Проверьте:

- есть ли скачок от факта к выводу без доказательства;

- не подменён ли термин (одно слово — разные смыслы);

- не перепутаны ли причины и следствия;

- нет ли «универсального» совета там, где нужен контекст.

Совет: Просите нейросеть выписать допущения явно. Часто ошибка спрятана именно там: «если X считается верным», «если применяется Y».

Prompt: Перепиши ответ в виде цепочки утверждений (1–10). Для каждого пункта укажи: это факт, вывод или допущение. Подсвети места, где нужны внешние подтверждения.

Шаг 4. Проверьте контекст: страна, дата, версия, аудитория

Одна из самых частых причин, почему ИИ «уверенно врёт», — он отвечает для другой страны, другой даты или другой версии сервиса. В результате текст выглядит правильным, но на практике неприменим.

Проверьте четыре контекстных маркера:

- География: Россия/Турция/ЕС/США — разные нормы и процессы.

- Дата: правила могли измениться.

- Версия продукта: интерфейс и функции могли обновиться.

- Аудитория: новичок/профи, клиент/сотрудник, публично/внутренне.

Важно: Если ответ содержит «точные» сроки, штрафы, цены, нормы или процедуры — без привязки к стране и дате — вероятность ошибки резко возрастает.

Шаг 5. Перепроверьте ключевые утверждения по независимым источникам

Когда факты отделены от интерпретаций, проверьте 3–7 самых важных утверждений «снаружи». Не надо проверять всё — надо проверить то, что решает задачу.

Практический минимум:

- проверить определения и термины (чтобы не строить выводы на неправильном смысле);

- проверить цифры и даты;

- проверить нормативные ссылки;

- проверить «обязательные» требования («нельзя», «должны», «обязаны»).

Если вы работаете с текстом (инструкцией, письмом, статьёй), добавьте проверку внутренних противоречий и стилистических «следов уверенной ошибки». Для практичного чек-листа можно опираться на материал: Как проверить текст от ИИ: факты, логика, стиль (чек-лист).

Шаг 6. Оформите итог: что подтверждено, что требует решения человека

На этом шаге вы превращаете ответ ИИ в безопасный результат. Сделайте простую маркировку:

| Часть ответа | Статус | Как проверено | Что делаем дальше |

|---|---|---|---|

| Цифры/даты/нормы | Подтверждено / Не подтверждено | Официальный источник / 2 независимых источника | Используем / заменяем / убираем |

| Рекомендации | Гипотеза | Сравнение вариантов, опыт, политика компании | Решает человек |

| Шаги инструкции | Нужно проверить применимость | Тест на практике / документация | Проверяем на «песочнице» |

Важно: Если вы не можете подтвердить факт — он не должен попадать в финальный документ как факт. Максимум — как гипотеза с пометкой «требует проверки».

Можно ли доверять ИИ без проверки

Доверять ИИ без проверки можно только там, где цена ошибки низкая, а результат легко откатить. Например: черновик письма, идеи, варианты структуры, переформулировки. Но как только речь идёт о фактах, инструкциях, правилах, цифрах и публичных заявлениях — проверка обязательна.

Если вы хотите лучше понимать природу ошибок, полезно разобрать базовую механику «галлюцинаций» и признаки того, что нейросеть «додумывает». Для этого подходит материал: Почему ИИ "галлюцинирует": как распознать ошибки и не облажаться.

Совет: В рабочем процессе используйте правило: «ИИ ускоряет подготовку, человек подтверждает факты». Это снимает иллюзию экспертности.

Как снизить риск ошибок заранее

Проверка — это реакция. Но лучше настроить работу так, чтобы ИИ ошибался реже и чтобы ошибки было проще отлавливать.

- Задавайте рамки: страна, дата, контекст, допустимые источники.

- Просите структуру и допущения: пусть нейросеть покажет, на чём стоит ответ.

- Запрашивайте альтернативы: «дай 3 варианта и риски каждого».

- Вводите проверочные вопросы: «что в этом может быть неверно?»

- Отделяйте черновик от финала: ИИ делает черновик, финал собирает человек.

Prompt: Перед тем как я использую ответ, проведи самопроверку: перечисли 7 мест, где ты мог ошибиться или «достроить» факты. Для каждого пункта предложи, как быстро подтвердить или опровергнуть.

Если у вас на сайте есть Конструктор промптов (Prompt Builder), можно собрать на его основе стандартный «шаблон проверки» для команды — но упоминать этот инструмент достаточно один раз: важнее внедрить привычку подтверждать ключевые факты.

Ограничения и риски: где протокол должен быть жёстче

Есть категории задач, где «уверенная ложь» ИИ опаснее всего. Для них протокол проверки должен быть максимальным, а иногда ИИ вообще лучше не использовать как источник фактов.

- Юридические решения: договоры, претензии, ссылки на нормы, сроки и ответственность.

- Финансы и налоги: платежи, ставки, штрафы, отчётность.

- Медицина и здоровье: диагнозы, дозировки, лечение.

- Безопасность и доступы: пароли, конфигурации, внутренние данные.

- Публичные заявления: пресс-релизы, новости, данные «от имени компании».

Важно: Если задача касается персональных данных или корпоративных документов, сначала проверьте, можно ли вообще отправлять такие сведения в ИИ. Практический разбор — здесь: Что нельзя вставлять в ИИ из рабочих документов: персональные данные и риски.

Финальная человеческая ответственность: что должно остаться за вами

ИИ и нейросеть могут ускорить подготовку текста, подсказать структуру, предложить варианты формулировок, помочь собрать список вопросов или сценариев. Но они не берут на себя ответственность за последствия ошибок. Именно поэтому в конце протокола важно зафиксировать, что решает человек.

Практическое правило: человек подписывает, публикует, отправляет и принимает решения — значит человек подтверждает критические факты. Если вы внедрите этот принцип, «уверенная ложь» ИИ перестанет быть проблемой: она станет просто черновиком, который проходит через фильтр проверки.

Часто задаваемые вопросы (FAQ)

Почему ИИ врёт так уверенно?

Потому что модель оптимизирует связность и убедительность текста, а не проверяет истинность фактов. Уверенный стиль — часть формата ответа.

Как понять, что нейросеть придумала факт?

Чаще всего признаки такие: нет проверяемых источников, слишком точные цифры без ссылок, «официальный» тон при отсутствии документа, нестыковки по датам и контексту.

Что делать, если ИИ дал ссылку на несуществующий источник?

Считать утверждение неподтверждённым, убрать его из финала или заменить на данные из реального первичного источника. Не используйте «похожие» документы как доказательство.

Можно ли доверять ответам ИИ в работе?

Да, но как черновику и помощнику по структуре. Факты, цифры, правила и обязательные требования нужно подтверждать вручную.

Какие проверки спасают чаще всего?

Отделение фактов от интерпретаций, запрос источников, проверка контекста (страна/дата/версия) и перепроверка 3–7 ключевых утверждений по независимым источникам.

Как быстро проверить ответ нейросети, если нет времени?

Проверьте самое важное: цифры/даты/нормы, «нельзя/нужно/обязательно», и любые утверждения, которые влияют на решение. Остальное пометьте как гипотезу.

Кто отвечает за ошибку, если ИИ ввёл в заблуждение?

Человек, который использовал результат и принял решение. ИИ не несёт ответственности за последствия, поэтому финальная проверка и утверждение — всегда на пользователе.