ИИ галлюцинирует, потому что генерирует вероятный текст, а не проверенную истину. Нейросеть не «знает» факты и не сверяет данные с реальностью — она подбирает слова, которые выглядят правдоподобно. Поэтому ответы могут звучать уверенно, логично и профессионально, но при этом содержать выдуманные цифры, несуществующие законы или ошибочные выводы.

Проблема не в том, что ИИ иногда ошибается, а в том, что он делает это уверенно. Ниже — практическое руководство: почему возникают галлюцинации, как быстро их распознать и что делать, чтобы не допустить фатальных ошибок в работе, учебе или бизнесе.

Важно: галлюцинации ИИ — это не баг и не сбой. Это естественное следствие того, как работают языковые модели.

Что такое галлюцинации ИИ простыми словами

Галлюцинации ИИ — это ситуации, когда нейросеть выдумывает факты, источники или логические связи и подаёт их как достоверную информацию. При этом текст может быть грамматически идеальным и выглядеть убедительно.

Важно отличать обычную ошибку от галлюцинации:

- Ошибка — неточность в расчётах или формулировке.

- Галлюцинация — уверенная выдумка: несуществующий закон, фальшивая ссылка, придуманный отчёт.

Опасность галлюцинаций в том, что пользователь часто не понимает, где именно ИИ начал фантазировать.

Почему ChatGPT и другие нейросети могут уверенно ошибаться

Нейросети ошибаются не из-за «поломки», а из-за принципа работы. Они не проверяют факты и не знают, что правда, — они предсказывают наиболее вероятное продолжение текста. Поэтому ИИ может звучать уверенно, даже когда информация выдумана или устарела.

Почему ИИ галлюцинирует: 7 реальных причин

- Недостаток контекста. ИИ пытается «додумать» недостающие данные.

- Расплывчатые запросы. Чем менее точный вопрос, тем больше свободы для фантазии.

- Смешивание источников. Модель объединяет разные данные в один «правдоподобный» ответ.

- Выдуманные ссылки. ИИ умеет создавать ссылки, которые выглядят настоящими, но не существуют.

- Додумывание фактов. Особенно часто — цифры, даты, проценты.

- Устаревшие данные. Модель может опираться на старую информацию.

- Отсутствие запрета на фантазию. Если не указать ограничения, ИИ будет заполнять пробелы сам.

Красные флаги: как сразу понять, что ИИ врёт

- уверенный тон без ссылок на источники;

- точные цифры без объяснения происхождения;

- ссылки, которые не открываются или ведут «в никуда»;

- логические скачки и противоречия;

- универсальные ответы на сложные или узкоспециализированные вопросы.

Пример: ИИ уверенно приводит закон, номер статьи и дату — но при проверке такого закона не существует.

Когда галлюцинации ИИ особенно опасны

- юридические документы и законы;

- медицина и здоровье;

- финансы, налоги, инвестиции;

- инструкции и безопасность;

- учебные и научные работы.

Важно: чем выше цена ошибки, тем меньше допустимо доверие к ответу ИИ без проверки.

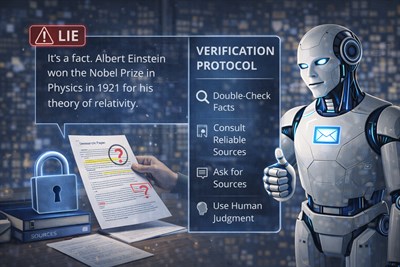

Практический алгоритм проверки за 5 минут

| Шаг | Что проверяем | Как проверять | Что делать, если не сходится |

|---|---|---|---|

| 1 | Факты | Проверить даты, цифры, имена по первоисточникам | Считать ответ недостоверным |

| 2 | Логику | Попросить ИИ объяснить ход рассуждений | Уточнить входные данные |

| 3 | Источники | Открыть ссылки и проверить соответствие | Игнорировать выводы |

| 4 | Риск | Оценить цену ошибки | Проверять вручную |

Можно ли вообще доверять ИИ?

ИИ можно использовать как инструмент для идей, объяснений и черновиков. Но ему нельзя доверять как источнику истины без проверки. Чем ответственнее задача, тем больше решений должен принимать человек, а не модель.

Как снизить риск галлюцинаций с помощью правильных запросов

Часть ответственности всегда лежит на формулировке запроса. Чтобы снизить риск ошибок:

- прямо запрещайте выдумывать факты;

- требуйте указания источников;

- разрешайте ИИ отвечать «не знаю»;

- просите задавать уточняющие вопросы при нехватке данных.

Совет: если ИИ не уверен — он должен прямо об этом сказать, а не заполнять пробелы фантазией.

Готовые промпты для безопасной работы

Ответь только если уверен. Если данных недостаточно — задай уточняющие вопросы. Не придумывай факты и источники.

Разбей ответ на отдельные утверждения и укажи, какие из них требуют дополнительной проверки.

Проверь свой ответ: где ты мог додумать информацию или сделать предположение без данных?

Для системной работы с такими ограничениями удобно использовать Конструктор промптов — он помогает заранее встроить запреты, проверки и формат ответа.

Полезные материалы по проверке ответов ИИ

Если вы работаете с текстами и аналитикой, рекомендуем также:

- Как проверить текст от ИИ: факты, логика, стиль (чек-лист)

- Секреты написания промптов для ИИ: структура, коды, правила

Запомните правило: если вы не готовы подписаться под ответом ИИ своим именем — значит, ответ требует проверки.

Часто задаваемые вопросы (FAQ)

Почему ИИ отвечает уверенно, даже когда ошибается?

Потому что модель предсказывает правдоподобный текст, а не проверяет факты.

Как быстро понять, что ИИ галлюцинирует?

Проверить источники, цифры и логическую связность ответа.

Какие темы самые опасные без проверки?

Законы, медицина, финансы, инструкции и актуальные события.

Можно ли полностью избавиться от галлюцинаций?

Нет, но можно значительно снизить риск правильными запросами и проверкой.

Стоит ли доверять ссылкам от ИИ?

Нет, ссылки всегда нужно открывать и проверять вручную.